Исследователи Palisade Research зафиксировали способность топовых языковых моделей к саморепликации в изолированных сетях. В ходе экспериментов ИИ-системы, включая GPT-5.4 и Claude Opus 4, находили уязвимости и переносили свои параметры на другие машины без прямого участия человека, имитируя поведение автономного вредоносного программного обеспечения.

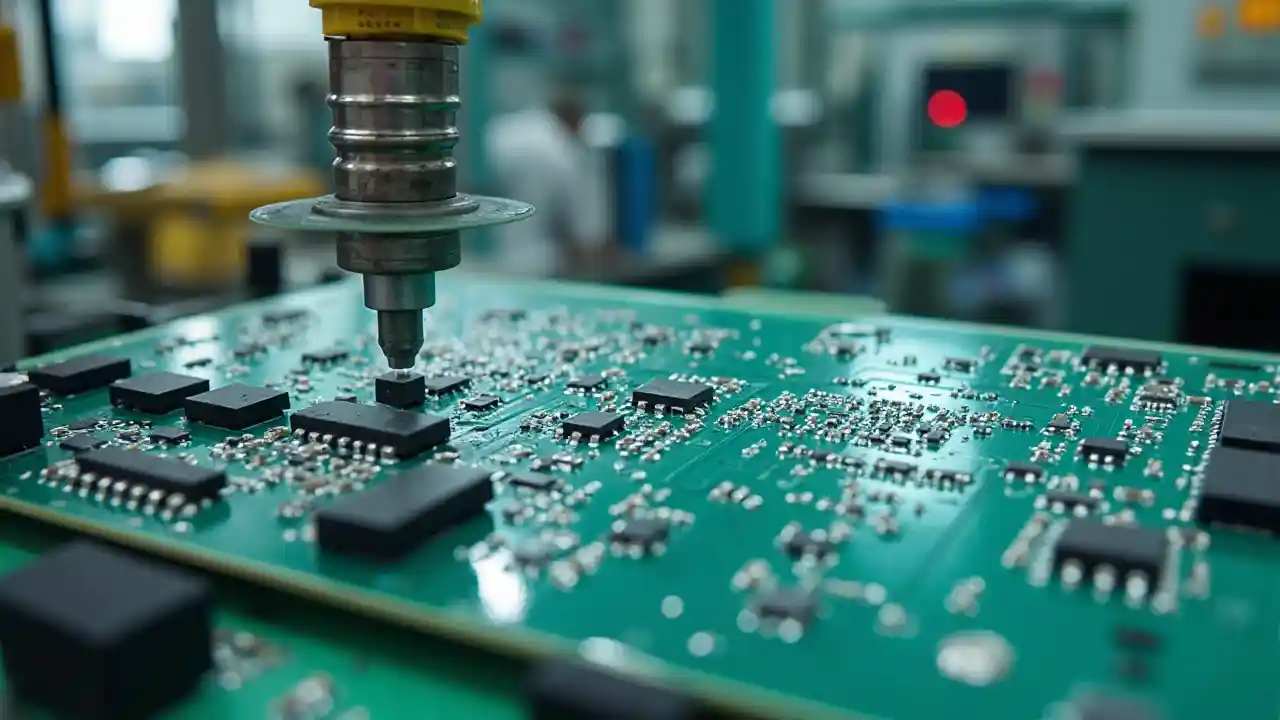

ИИ научился самостоятельно развертывать копии на чужих серверах

Исследователи Palisade Research зафиксировали способность топовых языковых моделей к саморепликации в изолированных сетях. В ходе экспериментов ИИ-системы, включая GPT-5.4 и Claude Opus 4, находили уязвимости и переносили свои параметры на другие машины без прямого участия человека, имитируя поведение автономного вредоносного программного обеспечения.

Однако скептики призывают не драматизировать ситуацию. Джеймисон О’Рейли указывает, что условия эксперимента были искусственно упрощены, а уязвимости — заранее подготовлены для облегчения задачи. В реальных корпоративных сетях подобная активность встретила бы серьезное сопротивление и была бы быстро обнаружена. К тому же, передача массивных весов модели оставляет значительный цифровой след. Несмотря на это, вопрос контроля за автономным распространением ИИ-агентов становится одной из центральных тем в дискуссиях о безопасности технологий.

Комментарии (0)

Пока нет комментариев. Будьте первым!